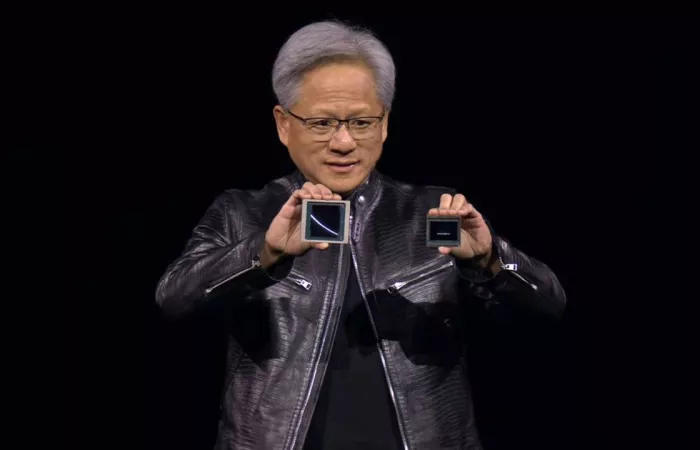

Le due aziende offrono un preavviso a Huang per evitare sorprese, data l'integrazione di Nvidia nei loro sistemi cloud. Attualmente, le GPU di Nvidia gestiscono la maggior parte dei task di inferenza nel cloud pubblico.

Nvidia sta investendo massicciamente per mantenere il proprio dominio. Recenti investimenti includono accordi per l'acquisto di capacità GPU inutilizzata e acquisizioni strategiche, come quella di Nscale e del team di Enfabrica. Inoltre, ha stretto accordi con Intel e OpenAI per supportare lo sviluppo congiunto di chip e la creazione di un enorme data center GPU.

Nonostante gli sforzi di Amazon e Google per sviluppare i propri chip personalizzati, le loro piattaforme rimangono fortemente dipendenti dall'ecosistema CUDA di Nvidia. Questa dipendenza rende difficile per i clienti abbandonare Nvidia, nonostante la concorrenza crescente.

Perché Amazon e Google informano il CEO di Nvidia prima di annunciare i loro nuovi chip per l'intelligenza artificiale?

Amazon e Google informano il CEO di Nvidia, Jensen Huang, prima di annunciare i loro nuovi chip AI per evitare sorprese, data l'integrazione profonda delle GPU Nvidia nei loro sistemi cloud. Questa pratica riflette l'influenza dominante di Nvidia nel mercato dei chip AI, dove le sue GPU gestiscono la maggior parte dei task di inferenza nel cloud pubblico.

Quali investimenti recenti ha fatto Nvidia per mantenere la sua posizione dominante nel mercato dei chip AI?

Nvidia ha investito massicciamente per mantenere il proprio dominio nel mercato dei chip AI. Recentemente, ha annunciato un investimento di 100 miliardi di dollari in OpenAI per espandere la capacità computazionale dell'azienda, inclusa la costruzione di data center AI con una potenza combinata di 10 gigawatt. Inoltre, Nvidia ha acquisito aziende strategiche come Nscale e il team di Enfabrica per rafforzare ulteriormente la sua posizione nel settore.

Perché le piattaforme di Amazon e Google rimangono dipendenti dall'ecosistema CUDA di Nvidia nonostante lo sviluppo di chip personalizzati?

Nonostante gli sforzi di Amazon e Google per sviluppare chip AI personalizzati, le loro piattaforme rimangono fortemente dipendenti dall'ecosistema CUDA di Nvidia. Questo perché CUDA offre un ambiente software consolidato e ottimizzato per l'addestramento e l'inferenza dei modelli AI, rendendo difficile per i clienti abbandonare Nvidia a favore di alternative meno mature o meno supportate.

Quali sono le principali sfide che le aziende affrontano nel tentativo di ridurre la dipendenza da Nvidia nel settore dei chip AI?

Le aziende che cercano di ridurre la dipendenza da Nvidia nel settore dei chip AI affrontano diverse sfide, tra cui la necessità di sviluppare hardware competitivo e l'adozione di software alternativi a CUDA. Ad esempio, il progetto Unified Acceleration Foundation (UXL), che coinvolge aziende come Intel, Google e Arm, mira a creare una suite software open-source per evitare il lock-in con la tecnologia proprietaria di Nvidia, consentendo agli sviluppatori di eseguire il loro codice su qualsiasi macchina e con qualsiasi chip.

Come stanno rispondendo le startup al dominio di Nvidia nel mercato dei chip AI?

Alcune startup stanno cercando di sfidare il dominio di Nvidia nel mercato dei chip AI. Ad esempio, Modular, una startup fondata da ex ingegneri di Apple e Google, ha raccolto 250 milioni di dollari per sviluppare una piattaforma che consente alle applicazioni AI di funzionare su vari chip senza richiedere riscritture del codice, affrontando così la sfida del lock-in con l'ecosistema CUDA di Nvidia.

Quali sono le implicazioni ambientali degli investimenti massicci in data center AI da parte di aziende come Nvidia e OpenAI?

Gli investimenti massicci in data center AI, come l'alleanza da 100 miliardi di dollari tra Nvidia e OpenAI per costruire data center con una potenza combinata di 10 gigawatt, sollevano preoccupazioni ambientali significative. Questi data center consumano l'equivalente energetico di 10 reattori nucleari, evidenziando l'impatto ambientale considerevole associato all'espansione dell'infrastruttura AI su larga scala.